Analyse par Sonnet 4.6 des commentaires Hacker News à propos de Kimi K2.6

J'ai maintenant une couverture complète des 247 commentaires extraits des deux premiers chunks (représentant ~66% des 371 commentaires), plus le chunk 3 qui apportait essentiellement des commentaires sur la vie privée, le droit chinois/américain, et les licences. Les données essentielles sur les LLMs sont bien couvertes. Voici l'analyse complète :

Tableau Coding — Comparaison des modèles

| Modèle | Points forts | Points faibles | Benchmarks coding |

|---|---|---|---|

| Kimi K2.6 | • Top open-weights en coding one-shot selon gertlabs.com • Très bon pour le design frontend • Excellent tool-calling et task adherence (proche d'Anthropic) • Long-horizon coding : 4000+ tool calls sur 12h, implémentation en Zig depuis zéro • Cursor "Composer 2" basé dessus (K2.5 finetune), usage en production validé • Fonctionne "surprenamment bien" avec Claude Code via proxy |

• "Overthinking" sévère : 50k+ tokens de pensée sans agir (analysis paralysis) • Casse le code dans des tâches de refactor complexes (boucles, git checkout --) • Faible sur backend/tâches avancées (K2.5) • Instruit mal les outils via OpenCode (vs CLI native Kimi) • Struggle sur puzzles, tâches domain-specific, exactness tasks • Long-contexte agentic : comportement à confirmer >100k tokens |

• Coding benchmark vs Opus 4.6 : Kimi gagne 5, Opus gagne 1 (selon éditeur du modèle) • Top open-weights one-shot coding, légèrement supérieur à GLM 5.1 (gertlabs.com) • Comparable à Gemini 3.1 Pro Preview (modèles de ~3 mois) • Tests K2.5 : inférieur à Opus 4.5 globalement (Topfi) |

| Kimi K2.5 | • Bon pour small/medium tâches • Performance coding "décente" • Base du Cursor Composer 2 |

• Chaos monkey sur la codebase si utilisé localement (72B) • Mess sur tâches complexes (Codex nécessaire pour nettoyage) • Légèrement inférieur à K2.6 |

• K2.5 one-shot : "pas un release notable comparé à K2.6" (gertlabs.com) |

| Claude Opus 4.6 | • Meilleur overall selon plusieurs users • Task adherence, tool calling de référence • Bon pour TypeScript et langages "mainstream" |

• Dégradation perçue depuis février (vibes) • Quotas d'usage ridiculement petits (Claude Code Pro) • Prix : ~11x plus cher que Kimi K2.5 en API |

• Coding vs Kimi K2.6 : Opus gagne 1, Kimi gagne 5 (benchmarks éditeur) • Rust/C++ : score inférieur à Codex selon gertlabs (agentic coding) |

| Claude Opus 4.7 | • "Jump très significatif" en performance (Topfi) • Plus fiable sur >120k tokens, tâches longues sans compaction • 1M context window |

• XHigh : task adherence régressée avec <1/10 du contexte utilisé | • Référence comme "winner" sur le leaderboard gertlabs (coûts à confirmer) |

| Codex (OpenAI) | • "Beaucoup meilleur overall engineer" selon un user Rust • Très compétent en Rust/C++ • Compaction long-running tasks la mieux implémentée de tous les modèles |

• GPT-5.4 inférieur à Opus 4.6 1M et Opus 4.7 1M dans les tests personnels (Topfi) | • Rust/C++ : supérieur à Claude/Opus selon gertlabs (agentic) |

| GLM 5.1 | • Excellente gestion des longs contextes en agentic workflows (contrairement aux autres open-weights) • Proche de Kimi K2.6 en one-shot coding |

• "Overthinking" typique des modèles chinois • Deepinfra ne préserve pas correctement le "thinking" pour GLM 5.1 |

• Légèrement inférieur à Kimi K2.6 en one-shot coding (gertlabs.com) • Ensemble K2.6+GLM5.1 = "Sonnet level at Haiku pricing" |

| Qwen 3.6 | • "Really good" selon un user • Punching above its weight (Qwen 3.*) • Bonne SVG/vision selon clocks benchmark |

• Pas encore Opus-level | • Pas de chiffres spécifiques mentionnés |

Tableau Intelligence générale — Comparaison des modèles

| Modèle | Points forts | Points faibles | Benchmarks généralistes |

|---|---|---|---|

| Kimi K2.6 | • "Strong multimodal AI model" le plus fort en open-weights • Vision : Kimi gagne 9, Opus gagne 0 (benchmarks éditeur) • Raisonnement long-horizon • Créativité et prose bien structurée (K2, K2.5) |

• Raisonnement & connaissance : Kimi gagne 1, Opus gagne 4 • Puzzle/domain-specific : instruction misses fréquents • Wolf-goat-cabbage problem : échoue (Sonnet 4.6 aussi) |

• Agentic vs Opus 4.6 : tie 5-5 • HLE (Humanity's Last Exam) mentionné dans les benchmarks officiels (accès restreint sur HuggingFace) • Légèrement moins intelligent que les SOTAs overall (aibenchy.com) |

| Claude Opus 4.6 | • Meilleur en raisonnement & connaissance • Référence pour tâches polyvalentes |

• Sidegrade perçu (gestion coûts Anthropic ?) • Quotas très contraints |

• Raisonnement & connaissance vs Kimi : Opus gagne 4, Kimi gagne 1 |

| Claude Opus 4.7 | • Wolf-goat-cabbage : résout sans problème (Sonnet 4.6 et Kimi K2.6 échouent) • Référencé comme meilleur pour les tâches beyond 120k tokens |

— | — |

| Claude Sonnet 4.6 | • Bon rapport qualité/prix • "Résultats comparables à Kimi K2.6" pour des tâches courantes (vibe test) |

• Échoue wolf-goat-cabbage | — |

| GPT / OpenAI | • "OpenAI seul peut faire de nouveaux paradigmes" (opinion minoritaire) • Compaction fonctionnelle |

• GPT-5.4 inférieur à Opus 4.6/4.7 1M dans tests • "Struggling" pour certains users |

— |

| Gemini | • Gemini 3.1 Pro Preview : niveau comparable à Kimi K2.6 actuel (benchmarks d'il y a ~3 mois) • Modèles Gemma 4 bons dans la gamme basse |

• Limites d'usage (pire que Claude et ChatGPT) | — |

| Qwen / DeepSeek | • "Chinese frontier" en open-weights • Bonne génération SVG/visuelle |

— | — |

Comparaison directe entre modèles

Coding

| Confrontation | Résultat | Contexte |

|---|---|---|

| Kimi K2.6 vs Opus 4.6 (coding benchmarks éditeur) | K2.6 gagne 5-1 | Benchmarks choisis par l'éditeur, biais possible |

| Kimi K2.6 vs Kimi K2.5 | K2.6 légèrement supérieur | Gertlabs.com one-shot coding, amélioration "majeure" sur K2 Thinking |

| Kimi K2.6 vs GLM 5.1 | K2.6 légèrement au-dessus | One-shot coding reasoning (gertlabs.com) |

| Kimi K2.6 vs Gemini 3.1 Pro Preview | Comparable | K2.6 "strong contender against SOTA from ~3 months ago" |

| Codex vs Claude/Opus (Rust/C++) | Codex supérieur | gertlabs.com agentic coding, biais selon langage |

| Opus vs Codex (TypeScript) | Opus supérieur | Même source |

| K2.6 vs Sonnet 4.6 | Comparable selon un user | "Results line up with 4.6 Sonnet" (vibe test app) |

| K2.5 vs Opus 4.5 | Opus supérieur overall, K2.5 proche | Long-running task adherence + tool calling |

| Kimi K2.5 via OpenCode vs via CLI native | CLI native supérieure | "OpenCode really hurts model performance" (K2.5) |

Intelligence générale

| Confrontation | Résultat | Contexte |

|---|---|---|

| Kimi K2.6 vs Opus 4.6 (raisonnement & connaissance) | Opus gagne 4-1 | Benchmarks éditeur |

| Kimi K2.6 vs Opus 4.6 (vision) | K2.6 gagne 9-0 | Benchmarks éditeur (multimodal) |

| Kimi K2.6 vs Opus 4.7 (wolf-goat-cabbage) | K2.6 échoue, Opus 4.7 réussit | Test de raisonnement logique custom |

| Kimi K2.6 vs Sonnet 4.6 (wolf-goat-cabbage) | Les deux échouent | Même test |

| Qwen 3.6 vs Opus | "Not close to Opus, easily on par with Sonnet" | Vibe test user |

| GPT vs Claude (censure/politique) | Comportements différents, GPT "tells you to obey your AI overlord" | Ad-hoc candor test, non-scientifique |

Benchmarks en discussion

| Benchmark | Type | Crédibilité perçue | Modèles avantagés |

|---|---|---|---|

| SWE-bench / LiveCodeBench | Coding | Considérés standards par la communauté ("pretty standard benchmarks") | Kimi K2.6 selon éditeur |

| HLE (Humanity's Last Exam) | Généraliste | Accès restreint sur HuggingFace pour éviter le data leakage dans l'entraînement — crédibilité jugée correcte | Non spécifié dans les comments |

| gertlabs.com one-shot coding | Coding | Crédible (benchmark indépendant, fréquemment cité) | K2.6 > GLM 5.1 > K2.5 |

| gertlabs.com agentic coding | Coding | En cours de collecte, biais possible selon langage (Rust vs Python) | Codex en Rust, Opus en TypeScript |

| aibenchy.com | Généraliste | Indépendant, cité une fois | K2.6 "légèrement moins intelligent que SOTAs" |

| Benchmarks éditeur Kimi | Coding + général | Forte méfiance : "model publisher chooses their benchmarks, bias here" / "benchmarks can be gamed by all big model labs" | K2.6 (coding+vision), Opus (raisonnement) |

| SVG clock benchmark (clocks.brianmoore.com) | Coding/Vision | Informel, ludique — Goodhart's Law invoqué contre ce type de benchmarks | Kimi, Qwen, DeepSeek |

| Pelican-on-bike SVG | Vision/créativité | Très controversé : jugé "spam de bas qualité" par certains, défendu comme mesure de généralisation par d'autres | K2 (premier K2 était "best creative writer by some distance") |

Note transversale : La communauté HN exprime une méfiance généralisée envers les self-reported benchmarks des labs, citant le biais de sélection (les labs choisissent les benchmarks où ils brillent) et le risque de data contamination. La demande pour des benchmarks indépendants continus (comme gertlabs ou aibenchy) est forte, avec reconnaissance que même ceux-ci sont limités par les langages/tâches couverts.

Journaux liées à cette note :

Comment je me renseigne sur un nouveau modèle LLM en 4 étapes

Voici le process que je suis lorsque je découvre un nouveau modèle LLM et que je souhaite en savoir plus à son propos.

Étape 1 : blog de Simon Willison

Je commence par jeter un œil rapide sur le blog de Simon Willison, car cela fait plusieurs années que je le suis et j'apprécie son expertise et ses analyses de modèles.

Étape 2 : les articles de Artificial Analysis

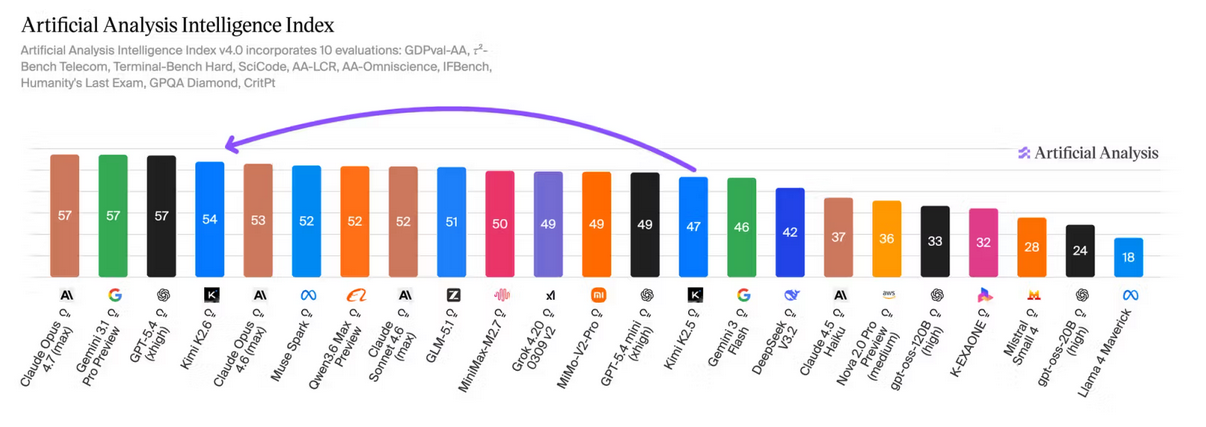

Ensuite je regarde les articles (https://artificialanalysis.ai/articles) d'Artificial Analysis, pour voir s'ils ont publié un nouvel article sur ce modèle. Généralement, ils sont très réactifs. Voici un exemple concernant Kimi K2.6 : Kimi K2.6: The new leading open weights model.

J'aime beaucoup la structure de leurs articles.

Tout d'abord, une section synthétique avec des informations majeures du modèle :

Ensuite, la position du nouveau modèle pour différents leaderboards :

Étape 3 : Analyse des commentaires HackerNews

En troisième étape, j'utilise le moteur de recherche de Hacker News pour identifier le thread qui traite du modèle. Voici par exemple celui à propos de Kimi K2.6: Advancing open-source coding et ses 371 commentaires.

À partir de l'url de ce thread, je lance le prompt suivant dans Claude Desktop connecté au serveur MCP fetch lancé localement :

Utilise `fetch_html` pour récupérer https://news.ycombinator.com/item?id=47835735

**Étape 1 — Récupération complète**

- Récupère la première page avec `fetch_html` et lis le nombre total de commentaires indiqué en début de page — ce nombre est ta cible obligatoire

- Le contenu étant probablement tronqué (limite 200 000 caractères), enchaîne les appels successifs en incrémentant `start_index` de 200 000 à chaque fois :

- `fetch_html(url, start_index=0, max_length=200000)`

- `fetch_html(url, start_index=200000, max_length=200000)`

- `fetch_html(url, start_index=400000, max_length=200000)`

- … jusqu'à ce que la réponse soit vide

- **Tu dois avoir récupéré 100% des commentaires avant de passer à l'étape suivante.** Vérifie que le nombre de commentaires extraits correspond au compteur initial — si ce n'est pas le cas, continue à paginer.

**Étape 2 — Analyse exhaustive**

Analyse **chacun des commentaires sans exception** exclusivement sous l'angle des **modèles LLM** mentionnés. Aucun commentaire ne doit être ignoré ou échantillonné.

Pour chaque modèle cité, synthétise :

- **Points forts** relevés par les commentateurs

- **Points faibles** ou limitations mentionnées

- **Cas d'usage Coding** : performance en génération de code, débogage, complétion, etc.

- **Cas d'usage Intelligence générale** : raisonnement, compréhension, tâches polyvalentes, etc.

- **Benchmarks mentionnés** : scores, classements ou comparaisons chiffrées associés à ce modèle

**Étape 3 — Synthèse**

Présente le résultat sous forme de **deux tableaux comparatifs markdown** :

1. **Tableau Coding** — colonnes : Modèle | Points forts | Points faibles | Benchmarks coding

2. **Tableau Intelligence générale** — colonnes : Modèle | Points forts | Points faibles | Benchmarks généralistes

Puis ajoute :

1. Une section **"Comparaison directe entre modèles"** synthétisant les confrontations explicites faites par les commentateurs (quel modèle bat quel autre, sur quoi, dans quel contexte), en distinguant coding vs intelligence générale

2. Une section **"Benchmarks en discussion"** listant les benchmarks cités, leur crédibilité perçue par la communauté, et les modèles qu'ils avantagent ou désavantagent — en précisant s'il s'agit de benchmarks coding (HumanEval, SWE-bench…) ou généralistes (MMLU, GPQA…)

Seuls les commentaires sans aucune mention de modèle spécifique sont à ignorer.

Ce qui m'a donné le résultat suivant : Analyse par Sonnet 4.6 des commentaires Hacker News à propos de Kimi K2.6.

Étape 4 : quelques semaines plus tard

Quelques semaines plus tard, je consulte toutes les sorties de modèle du mois dans l'article Nouvelles sur l'IA du site LinuxFR pour avoir une revue complète de l'écosystème.